Introduction

業務の効率化や自動化の推進、分析や判断のスピードと正確性の向上をめざし、AI導入に踏み切る企業が増えている。

一方で、AI導入にありがちな課題を抱えるケースが多数を占めている。

例えば、「PoC倒れが7割で、本番運用されるAIが少ない」「AIを導入したが利用されない」という課題だ。

こうした課題を解決するために、日立コンサルティングは、セミナー「AIの本番運用に立ちはだかる課題 ― 日立コンサルティングによる説明可能なAI(XAI)活用事例を交えて」を開催した。

ここで語られた「説明可能なAI(XAI)が解決の道を示す!」人とAIの協調についてレポートする。

![]()

01Challenges of AI operation and success story of XAI

AIの本番運用における

課題解決の一助となる

XAI(eXplainable AI)とは

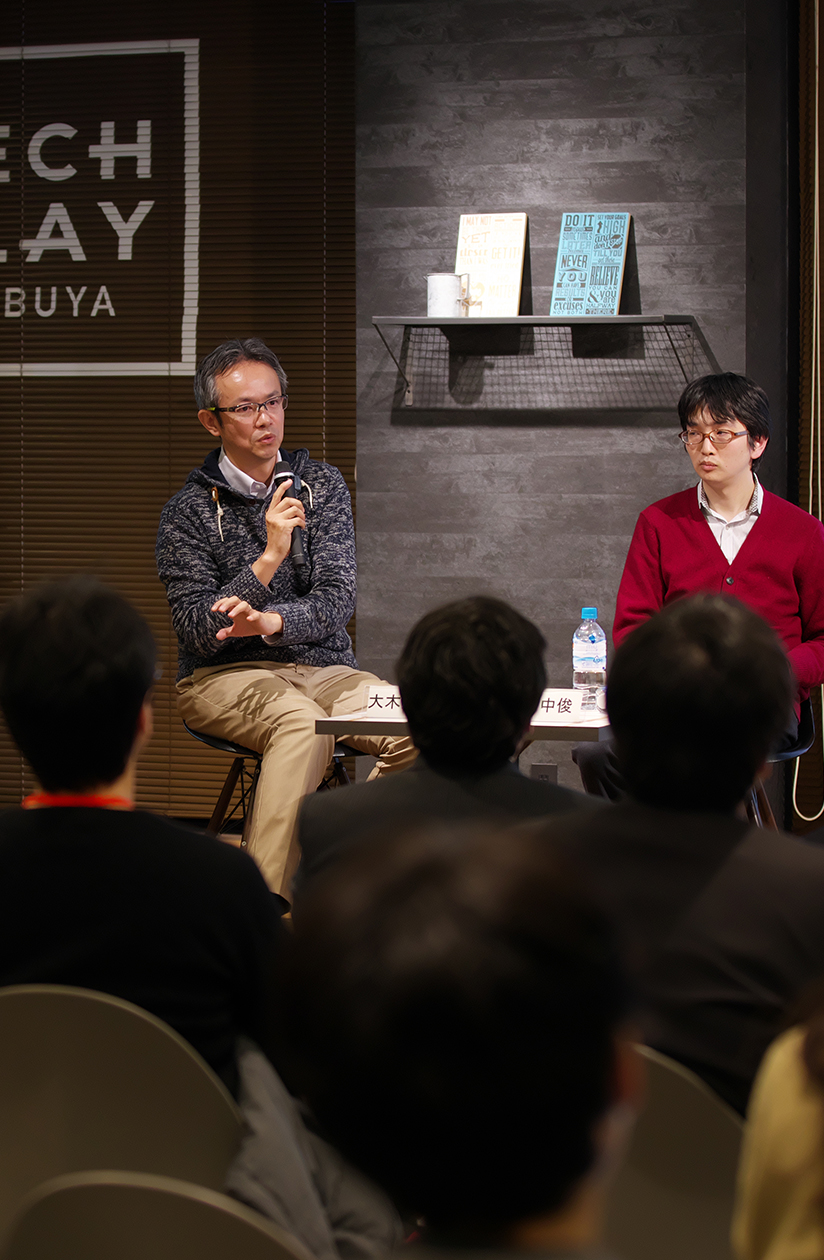

最初に登壇した田中が「説明可能なAI(XAI)登場の背景と、今後の実務でAIを活用する方向性」について語り、次に登壇した松井は、自身の体験に基づくXAIの事例を紹介した。

田中 俊(左)、松井 美沙紀(右)

田中 俊(左)、松井 美沙紀(右)

AIがどのように考えたのか、その挙動を説明できるXAIの重要性

AIの本番運用に立ちはだかる課題とは何か。PoC(実証実験)までで止まる例が7割超、現場の不信感による低い利用率など、AIをビジネスの現場に導入するために克服すべき課題は多い。こうした課題の解決方法の中でも、田中が注目するのは「XAIによる人とAIの対話」だ。

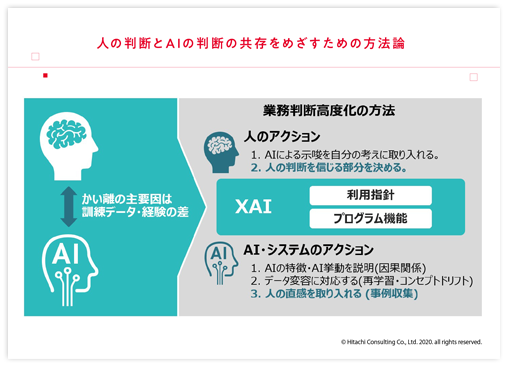

AIが導き出した回答を人に理解してもらうためには、回答を導き出すまでのプロセス(How)を明示するものと、因果関係(Why)を説明する方法がある。

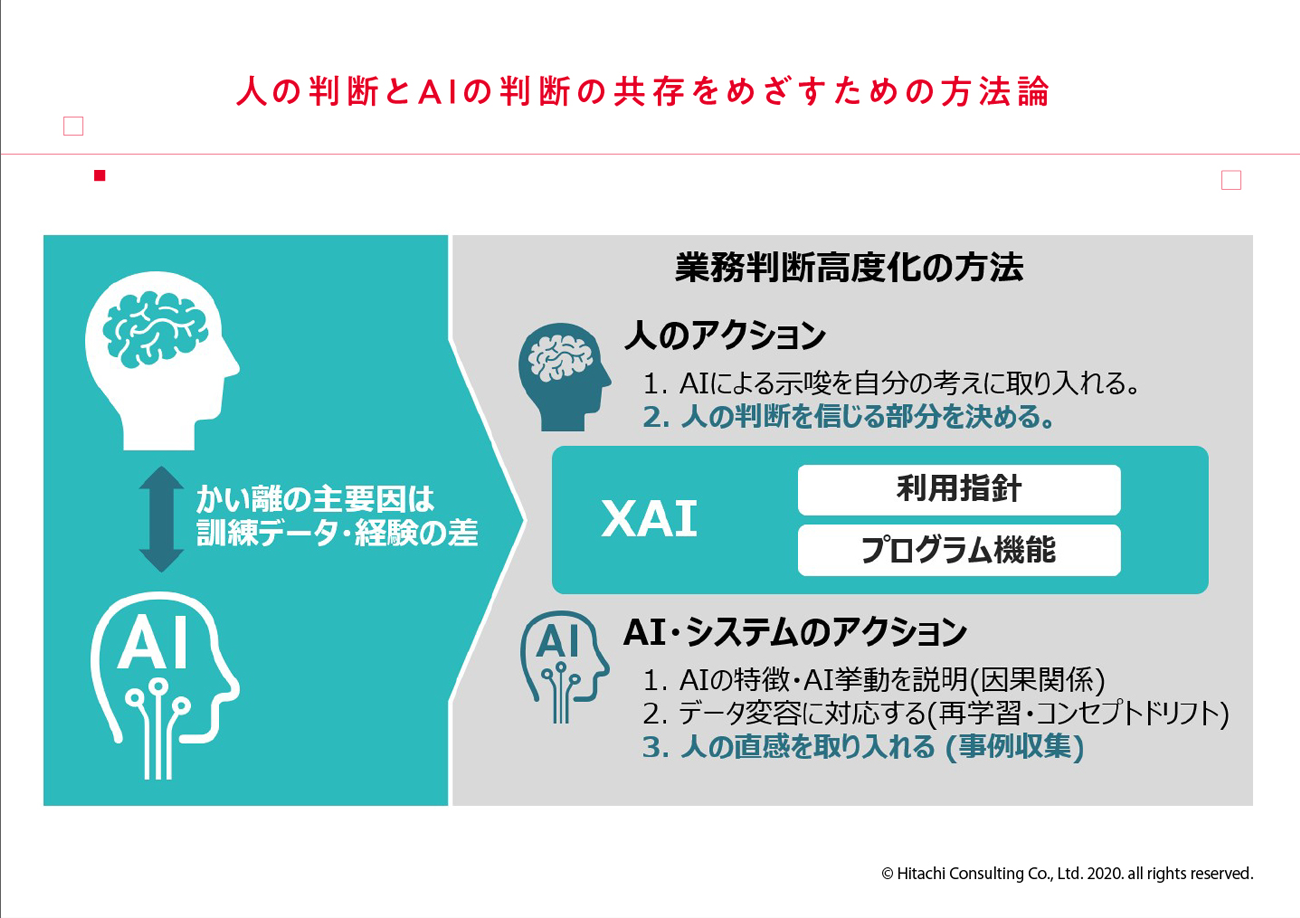

例えば、AIがA社に営業に行くべきだと提示してきたときに、営業担当者は、「なぜAIはそう考えたのか?」という因果関係(Why)を知りたがる。この疑問に対してプロセス(How)的な説明(機械学習アルゴリズムや利用データの説明)をしても意味はなく、「高い利益率が理由で営業先として推奨されています」といった因果関係になりえる説明(回答)が求められる。ところが、担当者に「なぜ私の考えと違うの?」という考え方のかい離が発生した場合には、因果関係を説明しても納得してもらえない。こういった状況に対して田中は「人の考えとかい離している説明は、AIの要素技術だけでは解決できない」と指摘する。AIが導き出した結論を人に納得してもらうためには、誰かに説明してもらう必要があるのだ。

AIを支える要素技術には、AIモデルの自動作成やチューニング(AutoML)に、強化学習フレーム(ABテスト・バンディットアルゴリズム)などがある。これらに加えて、AIの挙動を監視するだけではなく、その挙動を説明できるXAIの重要性が増している。田中は「重要な判断の高度化にAIを活用する場合は、XAIが必須となる」と提唱する。

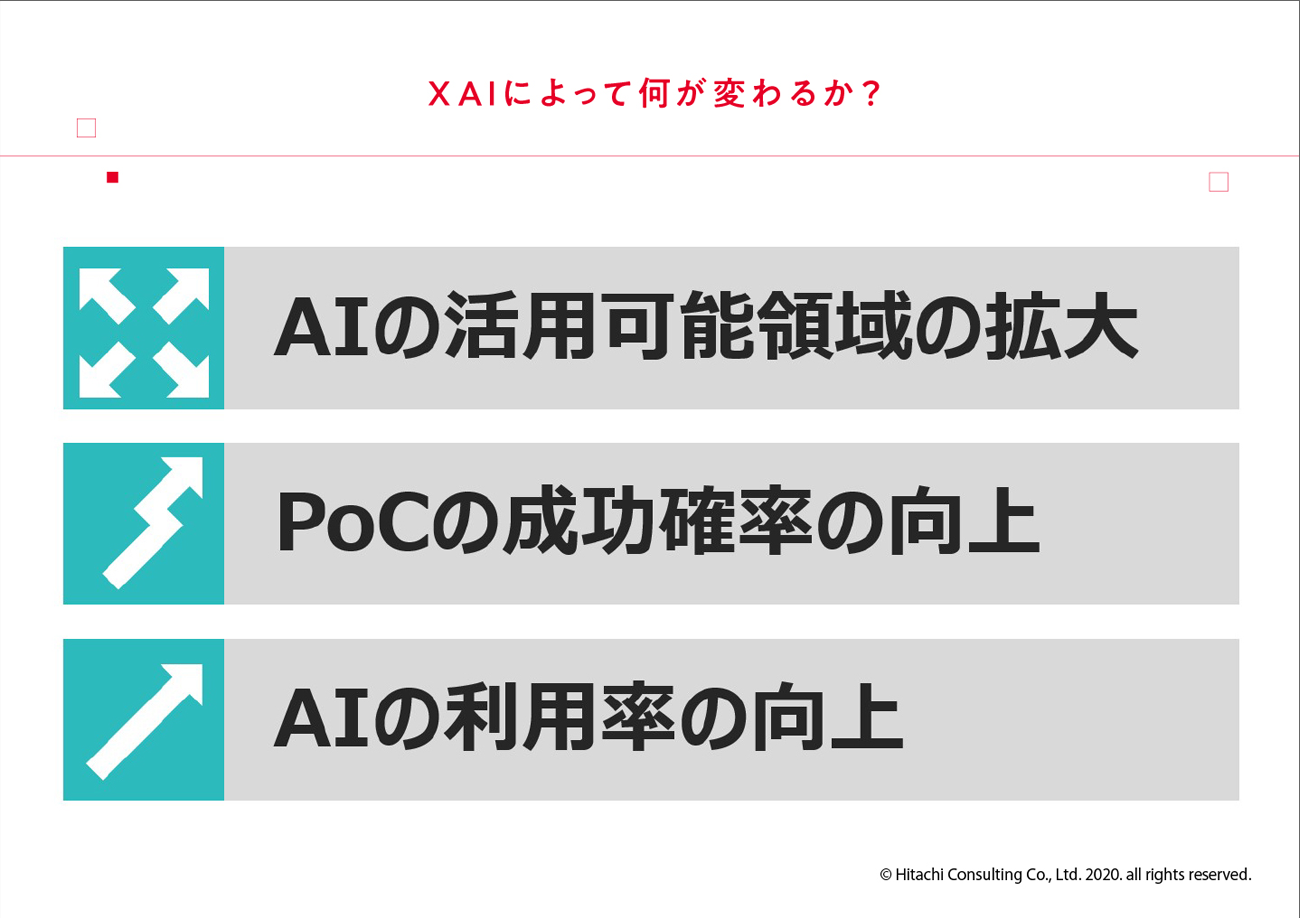

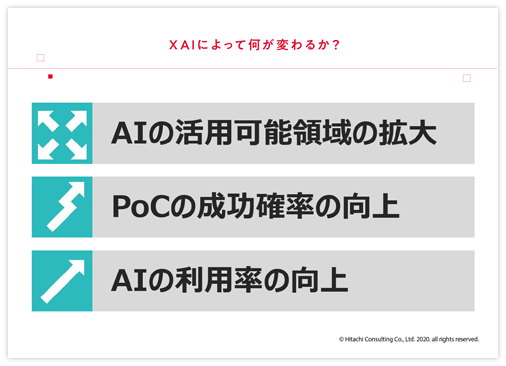

XAIで何が変わるのか。その本質を田中は「XAIによる人とAIの協調にある」と指摘する。その一例が、売り上げの継続的な向上に活用されるXAIだ。顧客にクーポンを配信するセールス活動において、配信のターゲットと施策を立案するXAIを導入したところ、配信ターゲットの選定理由を説明できるようになり、人の直感とAIの出力が組み合わさり、AI単独よりも配信の最適化が強化された。田中は「XAIを通して、人の考えとAIの出力のかい離を理解いただくと、AIの活用方法が変わる」と説明する。そして「対話型XAIで人とAIが協調できれば、単独では難しい高度な判断を実現できる」とAI活用の未来像を語った。

デフォルトリスク予兆検知AIへの不信感を

XAIで解決

データ分析などの案件を堅実に成し遂げてきた松井は、「デフォルトリスク予兆検知AI」案件で経験した「AIへの不信感を払拭」したXAI活用事例を語った。

松井が担当した企業の海外支社では、取引先のデフォルトによる実損害を低減するため、デフォルトリスクの兆候を早期に発見できるAIを求めていた。ところが、本社の与信管理の担当者から「私たちはすでにPLベースで、しっかり与信業務をしている。それにもかかわらず、AIのような正体の知れないものに業務を任せることなど考えられない」と否定されてしまった。リスク有りとAIが判断した要因が分からなければ、AIの出力結果を方針決定の根拠とすることができず、AIの業務への採用がストップしてしまう事態に陥ってしまった。

そこで、XAIを活用して個々の判断に影響を与えた要素を洗い出してみた。その結果、未払税金があること、また棚卸資産の比率が高いこともリスクありと判断した要因だという発見があった。松井は「棚卸資産の比率が高いことが現金化の遅れにつながり、運転資金を圧迫して支払い能力が低下するとAIが判断したのではないか、と説明したところ、この傾向が見られた取引先が実際に支払い遅延を起こしていた、とクライアントから伝えられました。AIの判断理由が分かったことで、クライアントや本社の与信管理担当者の納得を得られたことから、業務へのAI採用に向けた本格的な論議がスタートしました」と経緯を振り返る。

貴重な経験を得たことで、松井は「AIの出力結果をコンサルタントとして考察し、お客さまとディスカッションすることで、業務へのAI採用に納得感を持って取り組んでいただけると実感しました」と締めくくった。

02Panel discussion AI project talk

実務者が語る!

AI導入のホンネ

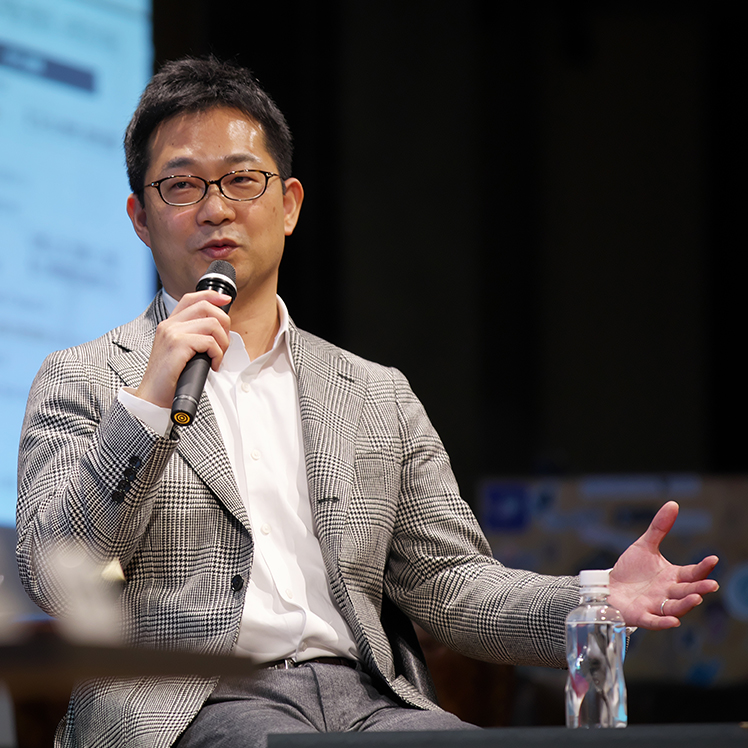

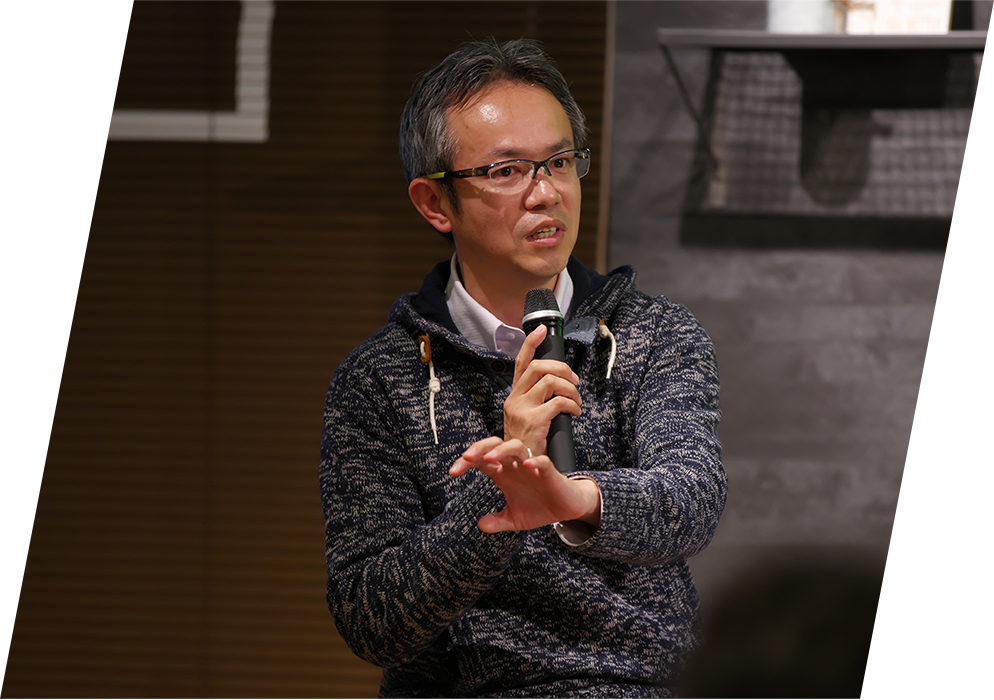

第二部では、パネルディスカッションの形式でAI案件に関する苦労や成果などが語られた。登壇したのは、第一部に引き続き田中と、AI案件の実務に携わっている大木康幸マネージャー、そして、これまで数々のDXコンサルティングを手がけてきた西岡千尋マネージングディレクターだ。ディスカッションにあたり、ファシリテーターを務めた西岡から4つのテーマが示された。

西岡 千尋

西岡 千尋 大木 康幸

大木 康幸 田中 俊

田中 俊

1AIの挙動説明で活用されるXAIツールとは?

西岡)大木さんも田中さんも、多数のAI案件に関わるなかでAIの挙動説明の大変さを経験していると思いますが、その本題に入る前に、まずは田中さん、最初のテーマである「XAIのツール」について、技術的な側面から解説してください。

田中)最もよく使うツールは、SHAP(SHapley Additive exPlanations)です。ゲーム理論に基づいて、AIの予測値を各特徴量の寄与に分解する手法で、個々の予測に対し、判断根拠を示すことができます。また、あるデータ周辺の傾向を見るときには、SHAPのほか、LIME(Local Interpretable Model-agnostic Explanations)を使うと便利です。画像解析への適用論文が有名で、どの部分を見て、画像を判定しているのかを可視化できます。さらに、エラーデータの発見などにInfluence Functionを使うこともあります。違和感のある予測が出た際に、個々の教師データの影響を算出できるからです。案件でよく使っているXAIのツールはこの3つになります。

大木)2016年ごろから、学会でもXAIに関するツールが取り上げられるようになり、田中さんが紹介した3つ以外にもオープンソースでも使えるさまざまなツールが提案されています。ただ、実案件で使う際の課題は計算にかかる時間です。案件で扱うデータ量により、1回の計算に数時間かかる場合があるため、どのツールをどのような目的で使うべきかの判断が、コンサルティングで重要になります。

西岡)XAIのツールは次々と新しいものが出てきています。そのような中で、どの技術を、どのプロジェクトで試すべきかなどの判断はどうされていますか?

田中)新しいツールを試す場合、当然われわれの学習コストがかかるので、利用ツールをアップデートするタイミングは、慎重に検討する必要があります。ただ、おもしろそうな技術は個人的にでも試してみようという姿勢でいます。

2XAIのニーズが増える業務と業種は?

― 海外ではすでにAIの説明責任が顕在化、日本も海外の動きを追随 ―

西岡)実務に関わっているお二人は、どのような業務・業種でXAIのニーズが増えると考えていますか。

田中)人の命が関わる分野はもちろんですが、金融庁からAIアルゴリズムの開示が求められる金融系の業務でも、XAIによるAIのホワイトボックス化が必要になっています。総務省のAI開発ガイドラインでも、AIの透明性や説明性を要求しています。海外では、GDPRの中で、AIが個人に対して判断を下した場合、個人にも判断の根拠を知る権利を与えるよう、企業に説明責任を求めています。例えば、クーポンを配信する際に、「なぜ自分には来ないのに友だちにだけ商品のクーポン配信が来るのか」といった比較的軽微なAI判断に対しても説明が必要となります。

大木)社会インフラに関わる需要予測にAIを導入しようとした事例がありました。社会に与えるインパクトが大きい分野ですので、そもそも予測が外れることは許されません。それでも万が一外れた場合、予測の根拠がわからないブラックボックス型のAIでは、再学習が難しくなります。そのため、顧客内でAIを導入すべきではないのでは?という議論になったことがありました。

重要な判断を下す分野へのAI導入では、原因分析のための説明がより重要になります。

田中)今後、AI導入の成否に関わらず、責任者にAIの出力結果に対する説明が求められるようになっていくと、XAIのニーズが増えるでしょう。現時点ではお客さま側では説明責任を明確にするための原因分析が必要かどうかは判断がつかない部分もあるため、こちらからお客さまにご提案する必要があります。

3AI業務でのXAI活用例とは?

― 実業務で経験したXAIの活用例 ―

西岡)大木さんは、実際にAIのプロジェクトで説明を求められた経験があるそうですが、AI業務でのXAIにはどのような活用例や効果があるのでしょうか。

大木)ある営業支援プロジェクトでAIの回答説明を行った際、営業担当者向けと幹部向けの説明に苦労しました。AIが営業担当者一人ひとりに対して予測した、どの会社に営業するべきか、どの商品を売るべきかという出力結果を、10名程の優秀な営業担当者に説明しましたが、さまざまな指摘の集中砲火を浴びました。

田中)説明にはどのような課題があったのですか。

大木)現場の営業担当者は“いかに営業成績を上げるか”を重視するので、データサイエンティストがAIの出力結果に対するプロセスや統計的な説明をしても、納得してもらえないのです。

西岡)データサイエンティストと業務部門との温度差ですね。データやテクノロジーを中心とした技術者の説明を、営業業務と結び付けて現場に分かってもらう難しさがありますね。

大木)営業の現場が知りたいのは、明日何を売れば成績が上がるかということなので、極論を言うと契約確率等の数値はどうでもよく、具体的なアクションのサジェストを知りたいのです。相手のニーズを理解し、それに沿った予測の解釈と説明を実施したところ、納得していただくことができました。

一方で幹部は、AIを導入するとどの程度もうかるのか、どのような新しい視点が出てくるのかを知りたがります。そこでXAIを活用して営業訪問事例を見せると、「もっとおもしろいものを探してきてくれ」とリクエストされました。

田中)具体的には、お客さまからはどんな反応がありましたか。

大木)だんだんと話に乗ってきて、質問が増えていきます。こういう場合はどうなのか、こうしたらどうなるのか、といった感じです。

そして説明が成功すると、次に何をするのかという営業活動の計画を立ててほしいと、新たな業務へのAI導入をリクエストされました。相手の立場やニーズを深く理解し、それに沿った説明をするかが、とても重要なことだと実感しました。

4XAI+AIで見える未来とは?

ー AIは相方や参謀になり得るか? ー

西岡)お客さまへの提案だけではなく、われわれも社内でAIを活用して働き方をよりよくしていこうと取り組んでいます。お二人はXAIとAIによって、どのような未来が訪れると予測しますか。

田中)人と人とが対話する会議では正しい意見だけではなく、示唆のある発言が求められます。これまでのAIは精度を追求してきましたが、AIにも将来的にはこのようなことが求められると思いますし、それはXAIを活用すれば可能になるのではないかと考えています。

例えば、売上の最大化を目的とした場合、直近1か月以内、あるいは1年間など、どの期間で最大化するかにより、短期型と長期型など、導入するAIの性質も変わります。そういったさまざまな性質を持つAIを使い分け、人が自らの判断の参考にするようになると、自分の考えを補完してくれるAI、相性の良いAIなどを選択できるようになるのではないでしょうか。

大木)初めはAIを精度の高い予測結果を出す技術として見ていたと思いますが、AIに説明をさせると、人からの質問が増えてきて、対話が生まれます。将来的には、参考意見を聞く、相方や参謀のような存在になるのではないかと考えています。

西岡)AIに仕事を奪われるのではないか、という意見もありますが、お二人のXAIの話を聞くと、人とAIが協調して働く未来がありそうですね。AIにもいろいろな種類と人格があって、その都度最適なものを選んで使うようになるとか。

大木)AIが参謀になると、利用シーンに合わせてAIの数が増えていくと考えています。リスクテイクが大好きなAIとか、ヘッジが大好きなAIとか。意思決定のためにさまざまなAIと連携するような未来が来るのではないでしょうか。

田中)AIがブレイン版のパワードスーツのように人の判断や予測をサポートする存在になるといいですね。

西岡)それはおもしろい考えですね。XAIによって、より実践的で説明が可能なAI活用の姿が見られたのではないかと思います。本日は、ありがとうございました。

-

- 西岡 千尋

-

株式会社 日立コンサルティング

デジタル・イノベーションコンサルティング事業部

デジタルイノベーションコンサルティング本部

マネージングディレクター

デジタル技術を活用した経営・業務改革、ベンチャーや研究所などの外部と連携したサービス開発に従事。

-

- 大木 康幸

-

株式会社 日立コンサルティング

デジタル・イノベーションコンサルティング事業部

デジタルイノベーションコンサルティング本部

マネージャー

映像・音声・文章・グラフデータ解析をネタにした新ソリューションを自分で作って売って直していたら、いつのまにかAIビジネス戦略・組織改革・標準化もするコンサル職に。最近の興味はXAI技術やAIガバナンス。

-

- 田中 俊

-

デジタル・イノベーションコンサルティング事業部

デジタルイノベーションコンサルティング本部

シニアコンサルタント

システム開発を経て、日立コンサルティングに入社。

機械学習コア製品策定など、AI関連プロジェクトを中心に従事。

コンサルタントでありながらデータサイエンティストでもあり、ピアニスト。

-

- 松井 美沙紀

-

株式会社 日立コンサルティング

デジタル・イノベーションコンサルティング事業部

デジタルイノベーションコンサルティング本部

コンサルタント

新卒入社以来、製造、金融、通信など幅広い分野で、機械学習・最適化技術を活用した業務改革の構想から実現に向けてデータを用いた実分析案件に従事。ロジカルにデータを扱う一方で、写真やデザイン、アートを好む右脳派コンサルタント。

日立コンサルティングのデジタル・イノベ-ションへの取り組みについて

「私たちは、日立グル-プで培った経験とノウハウを強みに

経営、事業企画、業務改革などに関わるコンサルティングを、さまざまなお客さまに提供しています。

今注目を集めるAIやイノベーションに関するサービスも得意としており

ビジネスにテクノロジーを取り入れたいお客さまのご要望に応えています。

今回ご紹介したXAIも、この一環として提供を開始したサービスの一つです。

これからもお客さまのデジタル・イノベーション実現に向けて尽力してまいりますので

私たちと一緒に未来を切り開いていきましょう」

デジタル・イノベーションコンサルティング事業部

デジタルイノベーションコンサルティング本部 本部長/マネージングディレクター

西岡 千尋

Features

-

Seminar

「デジタルトランスフォーメーションに向けた学校法人が取り組むワークスタイル変革とは?」 -

Solution

XAI(AIを説明するための技術)

活用コンサルティング

-

日立コンサルティングは、変革の先導役を担うコンサルタントを募集しております。

詳細はこちらから >

![]()